A febbraio, i dirigenti di OpenAI hanno visitato Los Angeles con la speranza di concludere accordi con i principali studi di Hollywood. Sono tornati a mani vuote.

Secondo Bloomberg, gli studi hanno rifiutato le collaborazioni per l’uso di Sora, lo strumento di generazione video basato su intelligenza artificiale di OpenAI, per via di timori legati all’uso dei loro dati e al potenziale contraccolpo da parte dei sindacati, ancora sensibili dopo gli scioperi di Hollywood del 2023.

Il fallimento di OpenAI nel conquistare Hollywood rivela un problema più profondo: l’azienda sembra riluttante a dimostrare di poter operare all’interno dei contratti, accordi di licenza e tutele sul lavoro che regolano il settore dell’intrattenimento da oltre un secolo.

OpenAI non sta solo alienando un’industria da oltre 100 miliardi di dollari: sta perdendo l’opportunità di dimostrare ad altri settori di poter costruire partnership solide e durature.

Il disastroso tentativo di OpenAI a Hollywood ricorda una disputa passata tra l’industria dei media e la Silicon Valley.

All’inizio degli anni 2000, Napster sembrava destinato a rivoluzionare il settore musicale offrendo agli utenti un catalogo digitale mai visto prima. Il servizio divenne un fenomeno culturale, ma si basava sulla distribuzione di musica non autorizzata (rubata), e il suo rifiuto di rispettare le leggi sul copyright si rivelò fatale.

Le etichette musicali fecero causa, e quando Napster capì che era meglio negoziare accordi di licenza, era ormai troppo tardi. L’industria musicale aveva già optato per accordi sostenibili con servizi come Rhapsody, iTunes e poi Spotify.

La tecnologia di OpenAI è molto più trasformativa di quella di Napster, ma la sua storia potrebbe finire allo stesso modo.

Come Napster, OpenAI non sembra capire che collaborare con le industrie consolidate è la strada migliore per una crescita a lungo termine.

Invece di coinvolgere i creatori, OpenAI ha fatto scraping di articoli di giornale, ha ingerito intere librerie di libri senza ottenere i diritti, e ha lanciato un assistente vocale che suonava molto simile a Scarlett Johansson (la quale aveva negato il consenso).

In seguito alle critiche sul caso Johansson, OpenAI ha dichiarato che la voce apparteneva a un’altra attrice non identificata e ha proseguito per la sua strada.

Questa strategia – muoversi in fretta e chiedere permesso dopo – può aver funzionato finora, ma non è sostenibile.

Un’IA amica degli studi

Come accadde con Napster, OpenAI sta aprendo la porta all’industria cinematografica per collaborare con aziende di IA che rispettano la proprietà intellettuale.

Lionsgate ha annunciato una partnership con Runway per creare un modello di IA proprietario addestrato esclusivamente sul catalogo dello studio. Il modello risultante sarà completamente trasparente e controllabile: Lionsgate saprà esattamente quali IP vengono utilizzati e potrà distribuire i ricavi internamente o reinvestirli.

Allo stesso modo, James Cameron ha collaborato con StabilityAI per portare l’IA negli effetti speciali, e il veterano del cinema Peter Chernin si è unito ad Andreessen Horowitz per lanciare uno studio nativo per l’IA, chiamato Promise.

Queste iniziative si distinguono da OpenAI perché usano solo dati con licenza, impiegano l’IA in flussi di lavoro controllati dagli artisti, o costruiscono nuovi studi con il coinvolgimento diretto di Hollywood.

Insistendo sul controllo e ignorando le preoccupazioni dei cineasti, OpenAI rischia di restare esclusa.

OpenAI dovrebbe imparare da altre aziende tecnologiche che inizialmente vedevano la regolamentazione come un ostacolo, ma in seguito ne hanno compreso i benefici – spesso dopo scontri con le autorità.

Ad esempio, Uber si presentava come un “disruptor”, ma alla fine ha collaborato con governi locali come quelli di Londra e Washington D.C. per ottenere contratti municipali e rafforzare la fiducia del mercato.

OpenAI ha ancora tempo per convincere le industrie tradizionali che può rispettare i diritti di proprietà intellettuale, la privacy dei dati e le norme sul lavoro.

Come primo passo, dovrebbe offrire maggiore trasparenza sui dati usati per l’addestramento dell’IA, aiutando studi e sindacati a capire quali materiali protetti da copyright sono stati utilizzati.

Un sistema di provenienza dei contenuti, capace di tracciare le uscite generate dall’IA – come sceneggiature o performance – non richiederebbe la divulgazione completa del modello.

OpenAI, gli studi e i creatori potrebbero affidarsi a audit indipendenti per certificare che i modelli siano stati sviluppati con restrizioni e standard concordati.

Tutto questo può avvenire senza compromettere informazioni proprietarie.

OpenAI dovrebbe inoltre accettare di condividere i ricavi con i detentori dei diritti in qualche forma.

Un sistema di royalty come quello di Spotify potrebbe non essere applicabile al cinema, ma l’idea di un fondo creativo è ancora valida – specialmente in casi controllati come l’accordo tra Runway e Lionsgate.

L’idea non è pagare per ogni utilizzo, ma licenziare dataset pre-approvati e condividere i ricavi legati ai contenuti generati da quei dati.

OpenAI a Hollywood

C’è una reale opportunità nel creare bundle di dati con licenza:

OpenAI potrebbe adottare un modello simile usando raccolte di contenuti protetti da copyright, sviluppate in collaborazione con i sindacati e i singoli studi. Anche un sistema limitato mostrerebbe la volontà di collaborare.

Il rischio maggiore per OpenAI non è sbagliare i dettagli—è restare ferma mentre i concorrenti vanno avanti.

In questo senso, conviene a OpenAI aprirsi di più a Hollywood – non solo agli studi, ma anche ai lavoratori e ai creatori.

Gli scioperi del 2023 hanno dimostrato che i sindacati sanno influenzare le narrazioni pubbliche e la politica, e qualsiasi strategia a lungo termine deve tenerne conto.

Destinare una parte dei ricavi generati dall’IA ai professionisti del settore indicherebbe l’intenzione di collaborare con il talento umano, non di aggirarlo.

Un’iniziativa del genere potrebbe ridefinire l’IA come partner creativo, non come minaccia, e aiutare OpenAI a distinguersi dai modelli generalisti opachi.

Il mese scorso, oltre 400 creativi di Hollywood hanno inviato una lettera alla Casa Bianca, sostenendo che le aziende di IA dovrebbero rispettare le leggi sul copyright come qualsiasi altro settore:

“Non c’è motivo di indebolire o eliminare le tutele del diritto d’autore che hanno contribuito alla prosperità dell’America”,

si legge nella lettera.

Più a lungo OpenAI aspetta, più lascia spazio agli altri per agire prima.

L’articolo completo è su Fortune.com

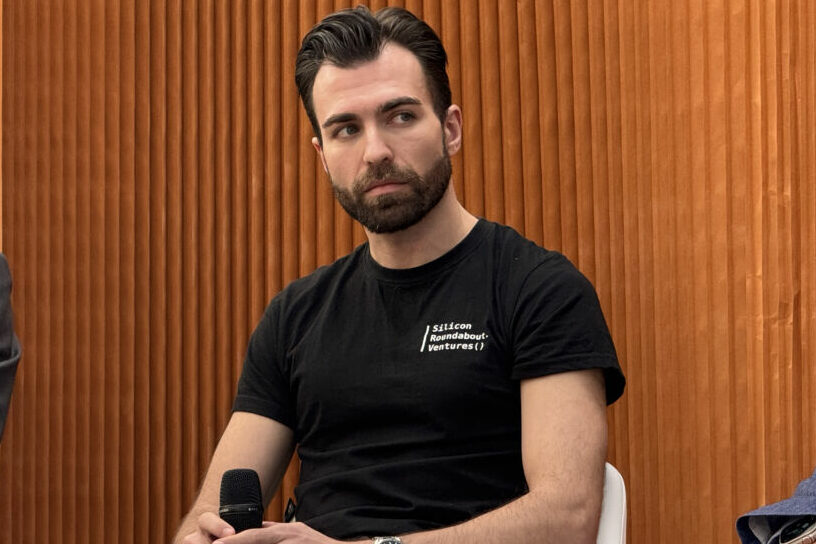

Matt Steinberg è un Tech e Public Policy Scholar della Georgetown University e ha una carriera alle spalle da dirigente cinematografico e televisivo.